Algoritma Gradient Descent pada Penerapan Data Science

Data Science merupakan salah satu bidang ilmu yang perkembangannya kian terasa di sekeliling kita. Tak pelak, keberadaan data science dapat mempermudah pekerjaan manusia yang mulanya rumit jadi lebih sederhana dan praktis. Penggunaan data science yang kita rasakan bersama sejatinya muncul dari dukungan algoritma yang berperan disana. Kalau ditanya apa saja algoritmanya tentu banyak dong. Sebab, setiap produk dari data science punya algoritma yang berbeda-beda. Salah satu algoritma yang akan kita bahas dalam artikel ini adalah algoritma gradient descent.

Algoritma gradient descent merupakan salah satu algoritma yang sangat penting dalam dunia data science, terutama dalam konteks machine learning. Algoritma ini memiliki peran utama dalam menemukan nilai minimum atau maksimum dari suatu fungsi, yang pada dasarnya digunakan untuk mengoptimalkan model atau menyesuaikan parameter agar sesuai dengan data yang ada. Ketika kamu mengaplikasikan algoritma ini maka pemahaman terkait matematika dan bahasa pemrograman tentu menjadi kunci utama. Oke, tanpa basa-basi lagi, kita akan bahas lebih dalam soal algoritma gradient descent ini.

Simak yuk sahabat DQLab!

1. Pengertian Algoritma Gradient Descent

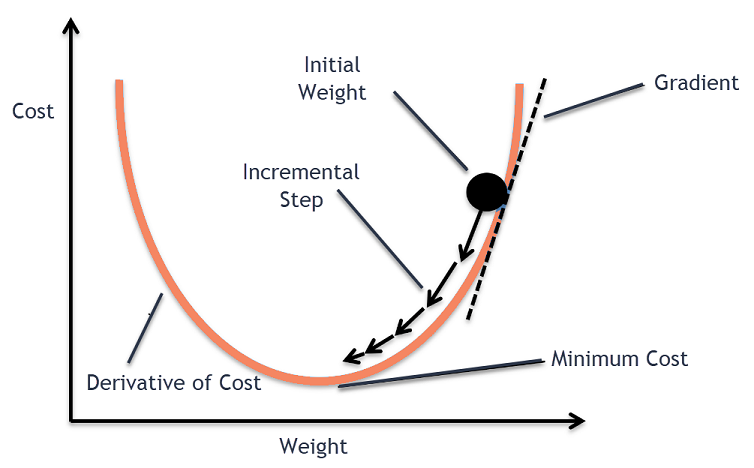

Algoritma Gradient Descent adalah metode optimasi yang digunakan untuk mencari nilai minimum dari suatu fungsi. Fungsi yang ingin dioptimalkan dapat mewakili kesalahan model dalam konteks machine learning atau fungsi biaya dalam berbagai masalah optimisasi. Prinsip dasar algoritma ini adalah iteratif menuruni "lembah" fungsi menuju nilai minimum dengan mengikuti arah turunan fungsi tersebut.

Terdapat beberapa varian dari algoritma Gradient Descent, termasuk Stochastic Gradient Descent (SGD) dan Mini-Batch Gradient Descent. SGD menggunakan satu titik data pada setiap iterasi, sementara Mini-Batch Gradient Descent menggunakan sejumlah kecil data (mini-batch) pada setiap iterasi. Varian-varian ini dapat membantu meningkatkan efisiensi dan skalabilitas algoritma, terutama ketika dataset sangat besar.

Sumber Gambar: Analytics Vidhya

Baca juga : Data Science Adalah: Yuk Kenali Lebih Jauh Tentang Data Science!

2. Cara Kerja Algoritma Gradient Descent

Secara umum, berikut adalah cara kerja dari algoritma gradient descent:

Inisialisasi Parameter: Tentukan nilai awal untuk parameter yang ingin dioptimalkan.

Perhitungan Gradien: Hitung gradien atau turunan parsial dari fungsi tujuan terhadap setiap parameter. Gradien ini memberikan informasi tentang kecepatan perubahan fungsi terhadap masing-masing parameter.

Update Parameter: Gunakan gradien untuk mengupdate nilai parameter. Proses ini dilakukan dengan mengurangkan nilai parameter dengan produk antara gradien dan suatu nilai yang disebut sebagai "learning rate" (tingkat pembelajaran). Learning rate menentukan seberapa besar langkah yang diambil pada setiap iterasi.

Iterasi: Ulangi langkah-langkah 2 dan 3 sampai suatu kriteria konvergensi terpenuhi atau jumlah iterasi yang ditentukan telah tercapai. Kriteria konvergensi biasanya melibatkan perbandingan perbedaan nilai fungsi antar iterasi atau perbandingan magnitudo gradien.

3. Penerapan Algoritma Gradient Descent dalam Kehidupan Sehari-hari

Meskipun algoritma Gradient Descent secara khusus dikembangkan untuk optimisasi dalam konteks machine learning dan matematika, prinsip dasarnya dapat diterapkan dalam berbagai aspek kehidupan sehari-hari. Berikut adalah beberapa contoh penerapan algoritma Gradient Descent dalam kehidupan nyata:

Penyesuaian Jadwal dan Produktivitas:

Tujuan: Memaksimalkan efisiensi waktu.

Parameter: Aktivitas harian, prioritas, dan waktu yang dihabiskan untuk setiap aktivitas.

Gradien: Perubahan efisiensi berdasarkan alokasi waktu dan hasil aktivitas.

Update Parameter: Penyesuaian jadwal dan prioritas berdasarkan evaluasi efisiensi dan hasil aktivitas sebelumnya.

Pengaturan Keuangan Pribadi:

Tujuan: Meminimalkan pengeluaran, memaksimalkan tabungan.

Parameter: Pengeluaran bulanan untuk setiap kategori, target tabungan.

Gradien: Perubahan total pengeluaran berdasarkan kategori dan perbandingan dengan target tabungan.

Update Parameter: Penyesuaian anggaran bulanan untuk mencapai target tabungan.

Diet dan Kesehatan:

Tujuan: Meminimalkan berat badan, maksimalkan kesehatan.

Parameter: Jenis dan jumlah makanan, tingkat aktivitas fisik.

Gradien: Perubahan berat badan berdasarkan pola makan dan aktivitas fisik.

Update Parameter: Penyesuaian diet dan rutin olahraga untuk mencapai tujuan kesehatan.

Baca juga : 3 Contoh Penerapan Data Science yang Sangat Berguna di Dunia Perindustrian

4. Keunggulan Algoritma Gradient Descent

Algoritma Gradient Descent memiliki beberapa keunggulan yang membuatnya menjadi metode optimisasi yang umum digunakan, terutama dalam konteks machine learning dan optimisasi parameter. Berikut adalah beberapa keunggulan utama dari algoritma Gradient Descent:

Efisiensi dan Skalabilitas: Algoritma Gradient Descent efisien dan dapat diimplementasikan pada dataset besar. Variannya seperti Stochastic Gradient Descent (SGD) dan Mini-Batch Gradient Descent memungkinkan pemrosesan yang lebih cepat, terutama ketika dataset sangat besar.

Konvergensi ke Optimum Lokal: Dalam banyak kasus, algoritma Gradient Descent dapat konvergen dengan baik ke optimum lokal atau global, tergantung pada bentuk fungsi yang dioptimalkan dan inisialisasi parameter awal. Ini membuatnya menjadi pilihan yang baik untuk banyak masalah optimisasi.

Aplikasi Luas: Algoritma Gradient Descent dapat diterapkan dalam berbagai konteks, termasuk machine learning, deep learning, dan optimisasi parameter pada berbagai masalah matematis. Fleksibilitas ini membuatnya menjadi algoritma yang umum digunakan di berbagai bidang.

Kemampuan Menangani Banyak Variabel: Algoritma ini dapat menangani masalah dengan jumlah variabel yang besar. Meskipun kompleksitas waktu dapat meningkat dengan jumlah variabel, namun dengan varian-varian seperti Stochastic Gradient Descent, di mana hanya sebagian data yang digunakan pada setiap iterasi, algoritma ini tetap dapat diaplikasikan secara efisien pada masalah dengan dimensi tinggi.

Jangan khawatir jika kamu pemula yang tidak memiliki background STEM karena gelar bukan halangan untuk menguasai ilmu data scientist agar bisa berkarir di industri 4.0. Buruan gabung bersama DQLab dengan Sign Up sekarang untuk #MulaiBelajarData di DQLab:

Buat Akun Gratis dengan Signup di DQLab.id/signup

Selesaikan modulenya, dapatkan sertifikat & reward menarik dari DQLab

Subscribe DQLab.id untuk Akses Semua Module Premium!

Penulis: Reyvan Maulid

Mulai Karier

sebagai Praktisi

Data Bersama

DQLab

Daftar sekarang dan ambil langkah

pertamamu untuk mengenal

Data Science.

Daftar Gratis & Mulai Belajar

Mulai perjalanan karier datamu bersama DQLab

Sudah punya akun? Kamu bisa Sign in disini