Cara Kerja Backpropagation dalam Model Machine Learning

Bayangkan ketika Sahabat DQ sedang berbicara dengan asisten virtual yang tahu persis apa yang kamu butuhkan pada suatu kondisi tertentu, atau bagaimana mobil bisa mengenali rambu lalu lintas dan mengambil keputusan sendiri. Itu bukan sihir, melainkan hasil dari jaringan saraf tiruan atau Neural Networks! Di balik kecanggihan ini, ada satu algoritma yang bekerja tanpa lelah agar sistem ini bisa belajar dari kesalahannya yakni algoritma Backpropagation.

Neural Networks menjadi otak di balik banyak teknologi mutakhir, mulai dari filter wajah di media sosial, rekomendasi film di platform streaming, hingga kecerdasan buatan dalam dunia medis. Namun, tanpa Backpropagation, semua itu tidak akan bekerja dengan efisien. Nah, kali ini kita akan mengupas bagaimana Backpropagation beroperasi, mengapa ia begitu penting, dan bagaimana kamu bisa memahami konsep ini dengan mudah!

1. Mengenal Neural Networks Backpropagation Algorithms

Backpropagation, atau Backward Propagation of Errors, adalah metode yang digunakan dalam pelatihan Neural Networks untuk mengurangi kesalahan dan meningkatkan akurasi model. Proses ini memungkinkan jaringan saraf untuk menyesuaikan bobot dan biasnya dengan cara yang lebih optimal melalui serangkaian iterasi.

Secara sederhana, Backpropagation bekerja dengan cara menghitung selisih antara output yang dihasilkan model dan output yang sebenarnya (disebut error atau loss). Error ini kemudian dihitung kembali ke lapisan-lapisan sebelumnya dalam jaringan untuk menyesuaikan bobot neuron, sehingga pada iterasi berikutnya, model dapat memberikan prediksi yang lebih akurat.

2. Mengapa Backpropagation Itu Penting?

Bayangkan kamu sedang belajar memasak resep baru. Setiap kali mencoba, hasilnya mungkin kurang sempurna. Tapi dengan mengevaluasi kesalahanmu, seperti terlalu banyak garam, terlalu sedikit bumbu, atau suhu terlalu tinggi, selanjutnya kamu bisa memperbaikinya di percobaan berikutnya. Nah, cara kerja Backpropagation ini mirip seperti itu!

Dalam konteks machine learning, Backpropagation penting karena:

Mempercepat pembelajaran model: Dengan menyesuaikan bobot berdasarkan error yang dihitung, model dapat belajar lebih cepat dan akurat.

Meningkatkan performa jaringan: Backpropagation membantu model mencapai tingkat akurasi yang lebih tinggi dengan mengurangi error secara iteratif.

Fleksibel dan bisa diterapkan ke berbagai kasus: Dari pengenalan gambar hingga pemrosesan bahasa alami, hampir semua Neural Networks modern mengandalkan Backpropagation untuk belajar.

Tanpa algoritma ini, model hanya akan mengandalkan metode coba-coba yang tidak efisien dan bisa memakan waktu sangat lama untuk mencapai hasil yang optimal.

Baca juga: Mengenal NLP, Salah Satu Produk Machine Learning

3. Bagaimana Cara Kerja Backpropagation?

Oke, sekarang kita masuk ke inti pembahasan: bagaimana Backpropagation sebenarnya bekerja?

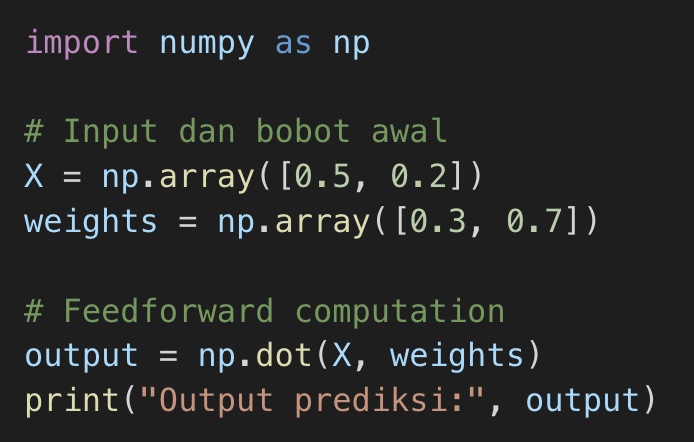

Feedforward (Maju ke Depan)

Pertama, input (data) diberikan ke jaringan, lalu dihitung melalui lapisan-lapisan neuron sampai menghasilkan output prediksi

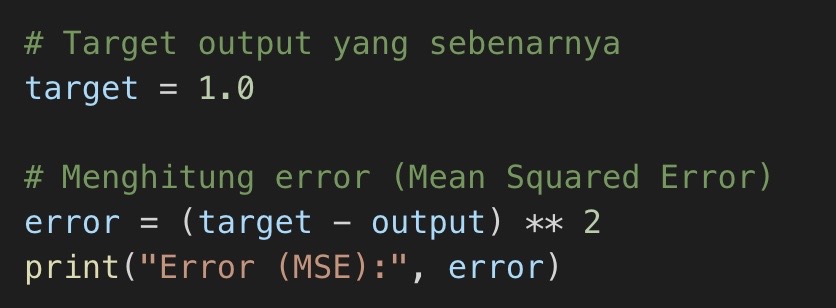

Menghitung Error (Loss Calculation)

Setelah mendapatkan output, kita membandingkannya dengan hasil yang sebenarnya. Perbedaan antara keduanya dihitung menggunakan fungsi loss seperti Mean Squared Error (MSE) atau Cross-Entropy.

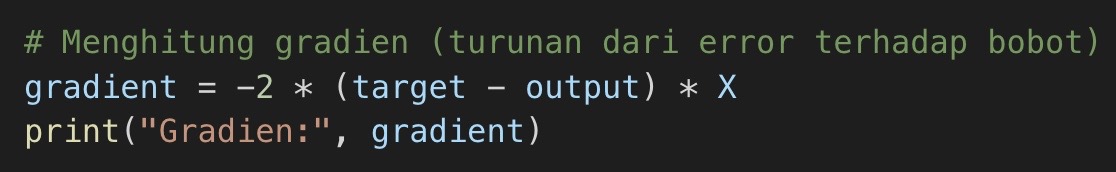

Backward Propagation (Mundur ke Belakang)

Setelah mengetahui seberapa besar error yang terjadi, Backpropagation menghitung kontribusi setiap neuron terhadap error tersebut. Dengan menggunakan chain rule dari kalkulus, error ini ditelusuri kembali ke lapisan sebelumnya untuk mengetahui bagaimana bobot harus diperbarui

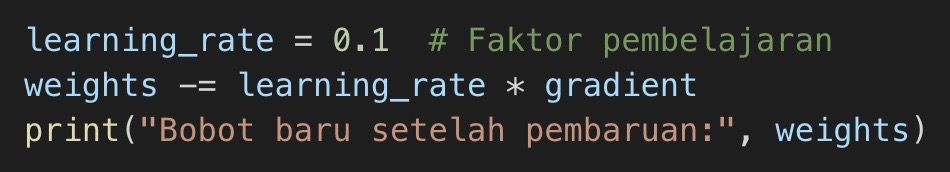

Update Bobot Menggunakan Gradient Descent

Setelah error dihitung, kita memperbarui bobot setiap neuron menggunakan metode Gradient Descent. Intinya, bobot diubah sedikit demi sedikit ke arah yang mengurangi error paling banyak.

Proses ini terus diulang hingga error yang dihasilkan semakin kecil, yang berarti model semakin akurat dalam membuat prediksi.

Baca juga: Bootcamp Machine Learning & AI for Beginner

4. Aspek Penting dalam Penerapan Backpropagation

Meskipun Backpropagation adalah algoritma yang sangat efektif, ada beberapa tantangan yang harus diperhatikan:

Vanishing Gradient Problem: Dalam jaringan yang sangat dalam, gradient dapat mengecil secara drastis, membuat pembelajaran menjadi lambat atau bahkan berhenti.

Overfitting: Jika model terlalu kompleks dan belajar terlalu banyak dari data pelatihan, bisa jadi model malah tidak bekerja dengan baik untuk data baru.

Pemilihan Learning Rate yang Tepat: Jika learning rate terlalu besar, model bisa melompat-lompat dan tidak mencapai hasil optimal. Jika terlalu kecil, pembelajaran bisa berjalan sangat lambat.

FAQ

Apakah Backpropagation hanya digunakan di Neural Networks?

Ya, Backpropagation secara khusus digunakan untuk melatih Neural Networks. Namun, konsep optimasi berbasis gradient descent juga diterapkan dalam berbagai algoritma lain di machine learning.

Apakah Backpropagation bisa digunakan tanpa Gradient Descent?

Tidak. Backpropagation hanya menghitung gradient error, sementara Gradient Descent yang bertugas memperbarui bobot berdasarkan perhitungan tersebut.

Apakah ada alternatif lain selain Backpropagation?

Ada! Beberapa alternatif lain seperti Genetic Algorithms, Reinforcement Learning, atau Hebbian Learning, meskipun Backpropagation tetap menjadi metode paling umum karena efisiensinya.

Nah, jadi gimana? Kamu tertarik untuk mempelajari terkait Neural Networks Backpropagation Algorithms secara lebih dalam, serta menerapkannya untuk pekerjaanmu? Yuk, segera Sign Up ke DQLab! Disini kamu bisa banget belajar dengan modul berkualitas dan tools sesuai kebutuhan industri dari dasar hingga advanced meskipun kamu nggak punya background IT, lho. Dilengkapi studi kasus yang membantu para pemula belajar memecahkan masalah secara langsung dari berbagai industri.

Tidak cuma itu, DQLab juga sudah menerapkan metode pembelajaran HERO (Hands-On, Experiential Learning & Outcome-based) yang dirancang ramah untuk pemula, dan telah terbukti mencetak talenta unggulan yang sukses berkarier di bidang data. Jadi, mau tunggu apa lagi? Yuk, segera persiapkan diri dengan modul premium atau kamu juga bisa mengikuti Bootcamp Machine Learning and AI for Beginner sekarang juga!

Penulis: Lisya Zuliasyari

Mulai Karier

sebagai Praktisi

Data Bersama

DQLab

Daftar sekarang dan ambil langkah

pertamamu untuk mengenal

Data Science.

Daftar Gratis & Mulai Belajar

Mulai perjalanan karier datamu bersama DQLab

Sudah punya akun? Kamu bisa Sign in disini