Serba Serbi Machine Learning Model Random Forest

Machine learning telah menjadi konsep atau ilmu yang semakin penting dan relevan dalam dunia teknologi dan data science. Dalam beberapa tahun terakhir, kemajuan dalam algoritma dan komputasi telah memungkinkan pengembangan model ML yang semakin kuat dan canggih. Dalam hal ini, juga semakin banyak model yang dikembangkan untuk mengatasi berbagai tugas, seperti klasifikasi, regresi, pengenalan pola, dan NLP.

Salah satu model machine learning yang sangat populer dan terbukti efektif dalam berbagai aplikasi adalah Random Forest. Random Forest adalah bentuk ensemble learning yang menggabungkan beberapa pohon keputusan dalam satu ensambel. Model ini terkenal karena kemampuannya untuk mengatasi overfitting, stabil dalam prediksi, dan kemampuannya untuk mengekstraksi fitur yang penting. Apakah model ini juga memiliki kekurangan? Adakah alternatif lainnya selain Random Forest? Yuk simak di sini!

1. Apa Itu Random Forest?

Sumber gambar: https://www.analyticsvidhya.com

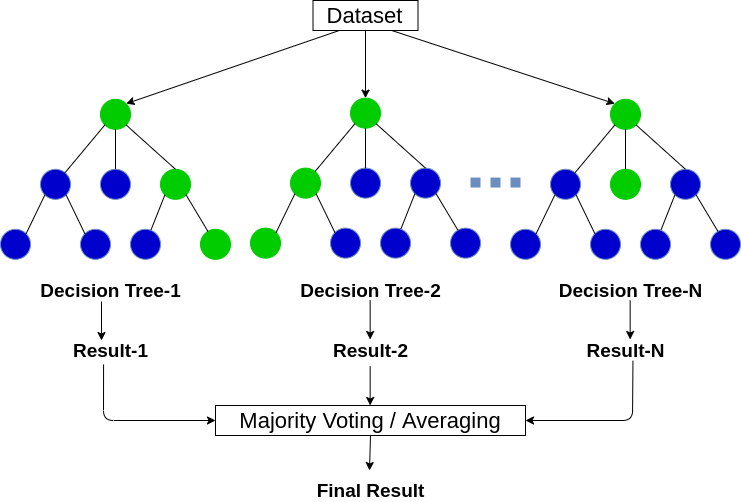

Random forest adalah sebuah model machine learning yang digunakan untuk tugas klasifikasi dan regresi. Algoritma ini merupakan bentuk ensemble learning, yang berarti menggabungkan beberapa model prediktif yang lebih sederhana untuk mencapai prediksi yang lebih akurat dan stabil.

Random forest terdiri dari kumpulan pohon keputusan yang bekerja secara independen. Setiap pohon keputusan dibangun dengan menggunakan sampel data yang diambil secara acak dari training dataset, serta menggunakan subset acak dari fitur yang tersedia. Konsep pengambilan sampel acak ini disebut dengan "Bootstrap Aggregating" atau "Bagging".

Proses pembentukan setiap pohon keputusan dalam Random Forest adalah sebagai berikut:

Pemilihan Sampel Acak: Dari dataset pelatihan yang tersedia, sampel data diambil secara acak dengan penggantian (bootstrap) untuk membentuk dataset yang berukuran sama dengan dataset pelatihan asli.

Pemilihan Fitur Acak: Dari jumlah fitur yang tersedia, subset fitur diambil secara acak untuk digunakan dalam membangun pohon keputusan. Biasanya, jumlah fitur yang diambil setiap kali jauh lebih kecil dari jumlah total fitur yang tersedia.

Membangun Pohon Keputusan: Dengan menggunakan sampel data dan subset fitur yang telah dipilih, pohon keputusan dibangun dengan menggunakan algoritma seperti ID3, C4.5, atau CART. Pohon ini dibentuk dengan melakukan pemisahan data berdasarkan fitur-fitur yang paling informatif, dengan tujuan untuk meminimalkan keragaman (variance) dalam setiap simpul pohon.

Pembentukan Ensambel: Langkah-langkah 1 hingga 3 diulang beberapa kali untuk membentuk kumpulan pohon keputusan. Setiap pohon keputusan dalam Random Forest memberikan suara atau memberikan prediksi terhadap kelas atau nilai regresi yang diinginkan.

Keputusan Majoritas: Prediksi akhir dalam Random Forest diperoleh dengan mengambil mayoritas suara atau rata-rata prediksi dari semua pohon keputusan dalam ensambel.

Baca juga : Yuk Kenali Macam-Macam Algoritma Machine Learning!

2. Kelebihan Random Forest

Random forest memiliki beberapa kelebihan yang membuatnya menjadi salah satu algoritma yang populer dalam machine learning. Berikut adalah beberapa kelebihan utamanya:

Mengatasi Overfitting: Random Forest mampu mengatasi masalah overfitting yang sering terjadi dalam model machine learning. Dengan menggunakan teknik bootstrap aggregating (bagging) dan pemilihan fitur acak, Random Forest dapat mengurangi varians dalam model dan meningkatkan generalisasi pada data baru.

Stabilitas: Random Forest cenderung lebih stabil daripada pohon keputusan tunggal. Karena Random Forest menggabungkan beberapa pohon keputusan yang independen, ia memiliki kemampuan yang lebih baik untuk menangani noise dan variasi dalam data, sehingga menghasilkan prediksi yang lebih konsisten dan andal.

Pengukuran Kepentingan Fitur: Random Forest dapat memberikan perkiraan kepentingan fitur yang digunakan dalam prediksi. Dengan menganalisis sejauh mana setiap fitur berkontribusi dalam memisahkan kelas target, Random Forest dapat memberikan insight berguna tentang fitur mana yang paling informatif.

Toleransi terhadap Data yang Tidak Seimbang: Random Forest dapat bekerja dengan baik pada dataset yang tidak seimbang, di mana jumlah contoh dari kelas target yang berbeda tidak proporsional. Dalam Random Forest, pengambilan sampel acak dan pembobotan kelas dapat digunakan untuk mengurangi efek ketidakseimbangan data dan menghasilkan prediksi yang lebih akurat untuk kelas yang kurang representatif.

3. Kekurangan Random Forest

Meskipun memiliki banyak kelebihan, Random Forest juga memiliki beberapa kekurangan yang perlu dipertimbangkan. Berikut adalah beberapa kekurangan tersebut:

Interpretabilitas yang Terbatas: Random Forest memiliki kemampuan untuk menghasilkan prediksi yang akurat. Namun, interpretabilitas model bisa menjadi tantangan. Karena Random Forest terdiri dari banyak pohon keputusan yang digabungkan, sehingga sulit untuk secara langsung menginterpretasikan pengaruh setiap fitur dalam membuat keputusan.

Parameter yang Perlu Diatur: Random Forest memiliki beberapa parameter yang perlu dikonfigurasi, seperti jumlah pohon dalam ensambel, jumlah fitur yang diambil secara acak, dan kriteria pemisahan pada setiap simpul pohon. Memilih parameter yang optimal dapat memerlukan eksperimen dan tuning yang cermat, terutama jika tidak ada pengetahuan sebelumnya tentang dataset yang digunakan.

Kesulitan dalam Penanganan Data Berdimensi Tinggi: Random Forest mungkin menghadapi tantangan dalam menangani data dengan dimensi yang sangat tinggi, yaitu ketika jumlah fitur sangat besar dibandingkan dengan jumlah sampel data yang tersedia. Dalam kasus seperti itu, pengambilan sampel acak dan pemilihan fitur acak mungkin tidak efektif dalam mengekstraksi pola yang relevan dan menghasilkan prediksi yang akurat.

Baca juga : Bootcamp Machine Learning and AI for Beginner

4. Alternatif Machine Learning Model Lainnya

Sumber gambar: https://www.javatpoint.com/

Terdapat banyak alternatif machine learning model lainnya yang dapat digunakan tergantung pada jenis tugas yang ingin diselesaikan. Berikut adalah beberapa alternatif populer:

Gradient Boosting Machines (GBM): Seperti Random Forest, GBM adalah metode ensemble yang menggabungkan beberapa model prediktif yang lebih sederhana. Namun, dalam GBM, setiap model berikutnya ditekankan pada kesalahan prediksi model sebelumnya, sehingga secara bertahap meningkatkan performa prediksi.

Support Vector Machines (SVM): SVM adalah model machine learning yang digunakan untuk tugas klasifikasi dan regresi. SVM bekerja dengan mencari hyperplane terbaik yang memisahkan kelas yang berbeda dalam ruang fitur.

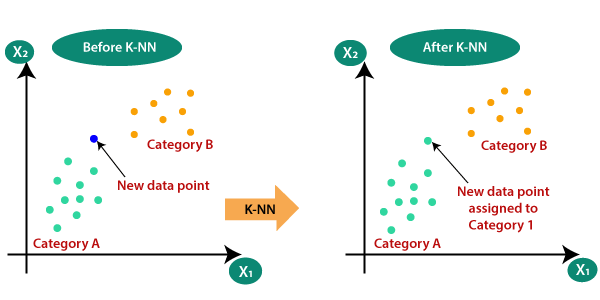

K-Nearest Neighbors (K-NN): K-NN adalah metode non-parametrik yang digunakan untuk klasifikasi dan regresi. Metode ini mencari k-nearest neighbors (tetangga terdekat) dari data yang sedang diprediksi dan memilih label mayoritas dari tetangga tersebut.

Decision Trees: Decision trees adalah model yang menggunakan struktur pohon untuk membuat prediksi berdasarkan fitur-fitur input. Setiap simpul dalam pohon mewakili keputusan berdasarkan fitur-fitur tertentu, dan prediksi dilakukan dengan mengikuti jalur dari akar hingga daun.

Setiap model memiliki karakteristik dan kekuatan uniknya sendiri, dan pemilihan model tergantung pada jenis data, kompleksitas tugas, dan tujuan yang ingin dicapai. Penting untuk memahami karakteristik masing-masing model sebelum memilih yang paling sesuai.

Ternyata pada machine learning ada banyak sekali model dan algoritma yang digunakan. Dimana ya bisa belajar semua materi tersebut? Tenang, DQLab solusinya. Modul ajarnya lengkap dan bervariasi. Semua skill yang dibutuhkan akan diajarkan. Dilengkapi studi kasus yang membantu kalian belajar memecahkan masalah dari berbagai industri. Bahkan diintegrasikan dengan ChatGPT. Manfaatnya apa?

Membantu kalian menjelaskan lebih detail code yang sedang dipelajari

Membantu menemukan code yang salah atau tidak sesuai

Memberikan solusi atas problem yang dihadapi pada code

Membantu kalian belajar kapanpun dan dimanapun

Selain itu, DQLab juga menggunakan metode HERO yaitu Hands-On, Experiential Learning & Outcome-based, yang dirancang ramah untuk pemula. Tunggu apa lagi, segera Sign Up dan persiapkan diri untuk menguasai machine learning dengan ikuti DQLab LiveClass Bootcamp Machine Learning and AI for Beginner!

Penulis : Dita Feby

Editor : Annissa Widya

Postingan Terkait

Menangkan Kompetisi Bisnis dengan Machine Learning

Mulai Karier

sebagai Praktisi

Data Bersama

DQLab

Daftar sekarang dan ambil langkah

pertamamu untuk mengenal

Data Science.

Daftar Gratis & Mulai Belajar

Mulai perjalanan karier datamu bersama DQLab

Sudah punya akun? Kamu bisa Sign in disini